В последние годы AI сделал большой шаг вперед и в основном благодаря большим языковым моделям (LLMs). LLMs очень хорошо понимают и генерируют текст, напоминающий человеческий, и они привели к созданию нескольких новых инструментов, таких как продвинутые чатботы и AI-писатели.

尽管LLMs在生成流畅且类似人类的文本方面表现出色,但有时它们在确保事实准确性方面会遇到困难。当准确性至关重要时,这可能是一个巨大的问题

Так что какая из solutioн этой проблемы? Ответ – Retrieval Augmented Generation (RAG).

RAG объединяет все мощные функции моделей, таких как GPT, и добавляет возможность искать информацию вне текущих источников, таких как официальные базы данных, статьи и содержимое. Это помогает AI-системе генерировать текст, который не только хорошо написан, но и более точный с правильными фактами и контекстуально правильный.

Когда сочетаются способность генерировать текст с возможностью найти и использовать точные и реlevantные данные, RAG открывает много новых возможностей. Он помогает закрыть пробел между AI, который просто пишет текст, и AI, который может использовать настоящие знания.

В этой статье мы более детально посмотрим на RAG, как он работает, где он используется и как может изменить наши взаимодействия с AI в будущем.

Что такое Retrieval Augmented Generation (RAG)?

Давайте начнем с официального определения RAG:

Получение улучшенной генерации (RAG) – это фреймворк ИИ, который улучшает большие языковые модели (LLMs) связывая их с внешними базами знаний. Это позволяет доступ к актуальной и точной информации, улучшая相关ность и фактическую точность его результатов.

Теперь попробуем сделать это проще, чтобы было легче понять.

Все мы вчера использовали IB чатботы, такие как ChatGPT, которые могут отвечать на наши вопросы. Этим управляют Большие Языковые Модели (LLMs), которые были обучены и созданы на основе огромного количества Интернет-содержимого/данных. Они прекрасно делают то, что создает похожее на человеческое текст по почти любому вопросу. Кажется, что они исправно отвечают на все наши вопросы, но это не совсем так. Иногда они рассказывают информацию, которая может оказаться неточной и неправдоподобной.

В этом месте начинает действовать RAG. Вот, как это работает (на very high уровне):

- Ты задаешь вопрос.

- RAG ищет справочную базу надежной информации.

- Он находит связанную информацию.

- Он передает эту информацию LLM.

- LLM использует эту точную информацию, чтобы ответить на тебя.

Результат этого процесса – это ответы, поддерживаемые точной информацией.

Представимся с примером: предположим, что вы хотите узнать о размещении багажа на международном рейсе. Традиционный LLM ChatGPT, скорее всего, скажет: “Обычно вам разрешено брать одну багажную книгу до 50 фунтов и одну допустимую сумку. Но проверьте данные с вашей авиакомпанией.” Система с усилением RAG скажет: “Для авиакомпании X пассажиры экономической категории получают одну багажную книгу до 50 фунтов и сумку до 17 фунтов. Бизнес-класс получает две багажные книги до 70 фунтов. Будьте бдительны по особым правилам для предметов, таких как спортивное оборудование, и всегда проверяйте информацию в момент регистрации.”

Вы заметили разница? RAG обеспечивает конкретные, более точные данные, настроенные на соответствие реальным политикам авиакомпаний.

Как работает RAG

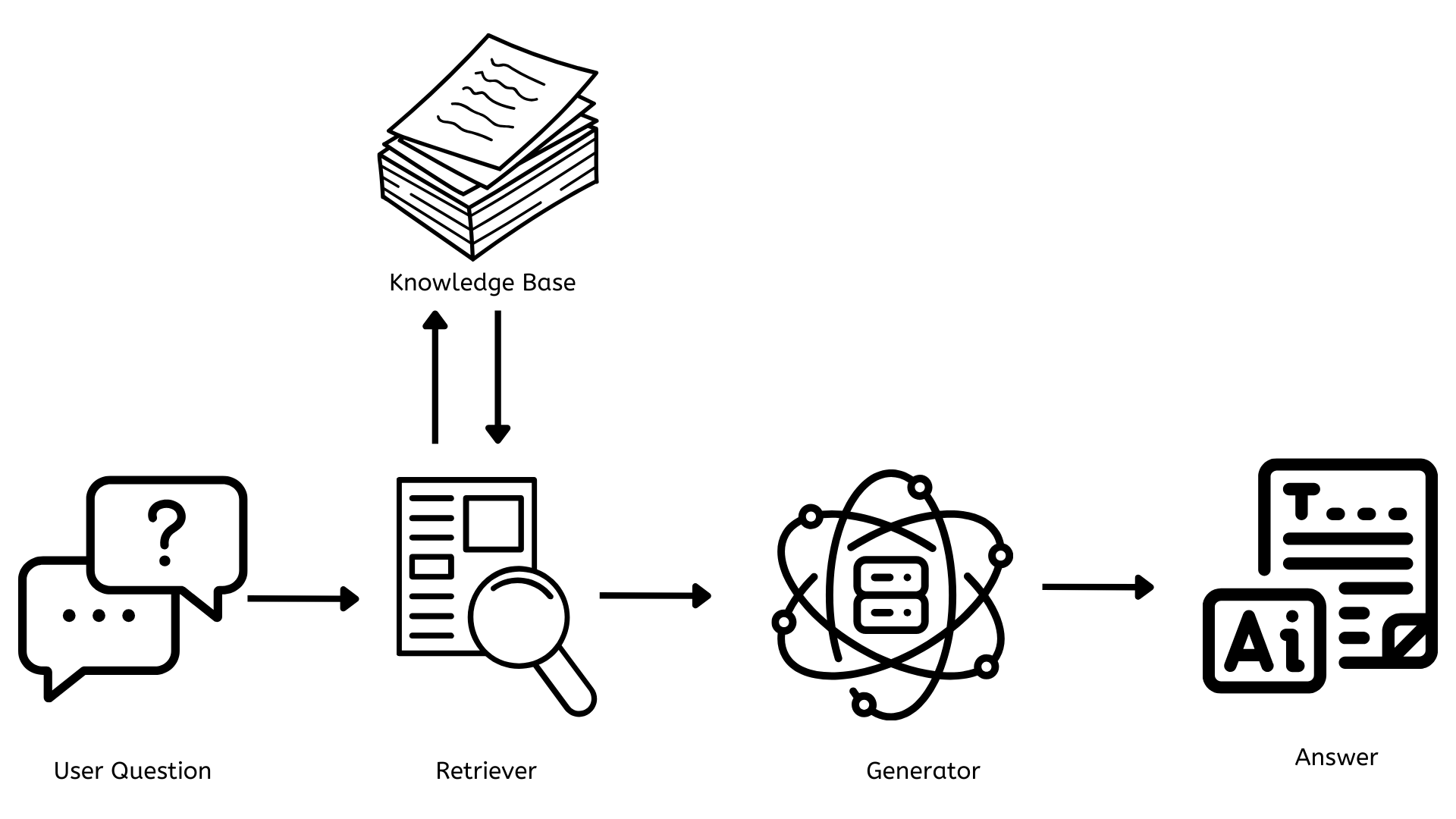

Теперь, когда мы хорошо понимаем, что за RAG, посмотрим, как она работает. Сначала рассмотрим простую архитектурную диаграмму.

Ключевые компоненты RAG

Согласно диаграмме архитектуры, между вопросом пользователя и окончательным ответом на вопрос существуют 3 ключевые компоненты, которые очень важны для работы RAG.

- Base of knowledge

- Retriever

- Generator

Теперь посмотрим на каждый компонент отдельно.

База знаний

Это хранение, которое содержит все документы, статьи или данные, которые можно использовать для ответа на все вопросы. Это необходимо обновлять постоянно с новыми и релевантными сведениями, чтобы ответы были точными, и пользователи получали наиболее релевантные и актуальные сведения.

С технической точки зрения, это, как правило, использует векторные базы данных , такие как Pinecone, FAISS и т. д., для хранения текста в качестве числовых представлений (ембеддинги), тем самым позволяя быстрые и эффективные поиски.

Поисковик

Он отвечает за нахождение релевантных документов или данных, связанных с вопросом пользователя. Когда появляется вопрос, поисковик быстро ищет наиболее релевантную информацию в базе знаний.

С технической точки зрения, это часто использует плотные методы поиска, такие как плотный поиск по параграфам или BM25. Эти методы преобразуют вопросы пользователя в тот же тип числового представления, используемый в базе знаний, и их соответствие с релевантной информацией.

Генератор

Он отвечает за генерацию содержимого, которое ясное и контекстуально релевантно вопросу пользователя. Он использует информацию от поисковика и использует ее, чтобы составить ответ, отвечающий на вопрос.

С технической точки зрения, это работает на основе большого языкового модели (LLM), такого как GPT-4 или открытых исходных альтернатив, таких как LLAMA или BERT. Эти модели тренируются на огромных наборах данных и могут генерировать похожее на человеческий текст на основе полученного входа.

Преимущества и приложения RAG

Теперь, когда мы знаем, что это за RAG и как она работает, let’s explore some of the benefits that it offers as well as applications of RAG.

Преимущества RAG

Актуальные знания

В отличие от традиционных моделей AI (ChatGPT), которые ограничены их тренировочными данными, системы RAG могут получить и использовать наиболее свежие информации, доступные в их базе знаний.

Улучшенная точность и уменьшение иллюзорных сообщений

Система RAG улучшает точность ответов, используя фактические, актуальные сведения из базы знаний. Это в значительной степени устраняет проблему “иллюзорных сообщений” – случаев, когда AI генерирует более правдоподобную, но неверную информацию.

Настраиваемость и специализация

Компаниям можно создать системы RAG на базе их специфических потребностей, используя специализированные базы знаний и создавая AI-ассистенты, являющиеся экспертами в определенных областях.

Прозрачность и объяснительность

Системы RAG часто могут предоставлять источники своих сведений, что помогает пользователям лучше понимать источники информации, проверять заявления и понимать основания за ответами.

Скалярность и Эффективность

RAG позволяет эффективно использовать вычислительные ресурсы. Вместо постоянной переподготовки больших моделей или создания новых из них, организации могут обновлять свои базы знаний, что упрощает масштабирование и обслуживание систем AI.

Приложения RAG

Сервис Клиента

RAG делает более умными и полезными чат-ботов для обслуживания клиентов. Эти боты могут получать самую последнюю информацию из базы знаний и предоставлять точные и контекстуальные ответы.

Персонализированные Ассистенты

Компании могут создаватьカスタマзированных AI Ассистентов, которые могут использовать их уникальные и закрытые данные. Используя внутренние документы политик, процедур и других данных организации, эти ассистенты могут быстро и эффективно отвечать на вопросы сотрудников.

Голос Клиента

Организации могут использовать RAG для анализа и определения действительно уместных взглядов из различных каналов обратной связи клиентов, что позволяет создать всестороннюю картину опыта клиентов, их настроений и потребностей. Это позволяет им быстро идентифицировать и решить важные вопросы, приниматьDATA-driven решения и непрерывно улучшать продукты на основе полной картины обратной связи клиентов по всему кругу контактов.

Будущее RAG

RAG стал игровым катастрофой в сфере искусственного интеллекта, объединяя силу крупных языковых моделей с динамическим информационным извлечением. Многие организации уже используют это и строятカスタム решения для своих нужд.

Присмотря на это, RAG изменит способ, как мы взаимодействуем с информацией и принимаем решения. будущие системы RAG будут:

- Possess greater contextual understanding and enhanced personalization

- Be multi-modal by going beyond just text and incorporating image, audio/video

- Have real-time knowledge base updates

- Have seamless integration with many workflows to improve productivity and enhance collaboration

Conclusion

В заключение, RAG изменит способ, как мы взаимодействуем с AI и информацией. При Closing the gap between AI-generated content and its factual accuracy, RAG поставит stage for intelligent AI systems that are not only more capable but also more accurate and trustworthy. Как это продолжает развиваться, наше взаимодействие с информацией будет более эффективным и точным, чем когда-либо раньше.

Source:

https://dzone.com/articles/rag-enhancing-ai-language-models