En récentes années, l’IA a fait des progrès importants, principalement grâce aux gros modèles de langue naturelle (LLMs). Les LLMs sont très bons à comprendre et à générer du texte ressemblant à celui d’une personne, et ils ont permis de créer plusieurs nouveaux outils tels que les robots de discussion avancés et les écrivains automatisés.

Bien que les LLMs soient excellents à générer du texte fluide et ressemblant à celui d’une personne, ils ont parfois du mal à avoir les faits à jour. Cela peut être un problème majeur lorsque l’exactitude est vraiment importante

Alors, quelle est la solution ? La réponse est La génération assistée par recherche (RAG).

RAG intègre toutes les fonctionnalités puissantes des modèles tels que GPT et ajoute également la capacité de rechercher des informations à l’extérieur, telles que les bases de données propres, les articles et le contenu. Cela aide l’IA à produire du texte qui n’est pas seulement bien écrit, mais également plus exact et pertinent dans le contexte.

En combinant la capacité de générer du texte avec le pouvoir de rechercher et d’utiliser des informations exactes et pertinentes, RAG ouvre de nombreuses nouvelles possibilités. Il aide à bridger le fossé entre l’IA qui écrit simplement du texte et l’IA qui peut utiliser des connaissances réelles.

Dans ce post, nous examinerons plus précisément RAG, comment il fonctionne, où il est utilisé et comment il pourrait changer notre interaction avec l’IA à l’avenir.

Qu’est-ce que la Génération Assistée par Recherche (RAG) ?

Commençons par une définition formelle de RAG :

Le RAG (Retrieval Augmented Generation) est un ensemble de logiciels d’IA qui améliore les grands modèles de langue (LLMs) en leur connectant des bases de connaissances externes. Cela permet d’accéder à des informations à jour et précises, améliorant ainsi la pertinence et l’exactitude factuelle de ses résultats.

Maintenant, décomposeons-le en langage simple pour qu’il soit facile à comprendre.

Tous les utilisateurs d’IA, comme ChatGPT, dans les deux dernières années, se sont avérés capables de répondre à nos questions. Ces assistants sont alimentés par des grands modèles de langue (LLMs), qui ont été entraînés et construits à partir de quantités énormes de contenu/données provenant d’internet. Ils sont excellents à produire du texte semblable à l’humain sur presque tout sujet. Il semble qu’ils soient parfaitement capables de répondre à toutes nos questions, mais ce n’est pas vrai en permanence. Ils partagent parfois des informations qui peuvent ne pas être exactes et correctes factuellement.

C’est là que rentre en jeu le RAG. Voici comment ça fonctionne (à un niveau très élevé) :

- Tu poses une question.

- Le RAG recherche une base de connaissances curée contenant des informations fiables.

- Il extrait les informations pertinentes.

- Il transmet cette information précise au LLM.

- Le LLM utilise cette information exacte pour te répondre.

Le résultat de ce processus est des réponses soutenues par des informations exactes.

Prenons un exemple pour mieux comprendre : imaginez que vous voulez savoir les règles de poids des bagages pour un vol international. Un traditional LLM comme ChatGPT pourrait répondre : « En général, vous pouvez emmener un bagage à mainjusqu’à 50 livres et un bagage de cabine. Cependant, vérifiez avec l’airline concernée pour les détails. » Un système amélioré RAG dirait : « Pour l’airline X, les passagers de classe économique peuvent emmener un bagage de 50 livres et un bagage de cabine de 17 livres. Les passagers de classe affaires peuvent emmener deux bagages de 70 livres. Attention aux règles spéciales sur les articles tels que le matériel sportif et vérifiez toujours à l’enregistrement. »

Avez-vous remarqué la différence ? RAG fournit des informations spécifiques et plus précises adaptées aux politiques réelles des airlines. En résumé, RAG rend ces systèmes plus fiables et plus dignes de confiance. Il est très important pour développer des systèmes d’IA plus fiables pour des applications réelles.

Comment fonctionne RAG

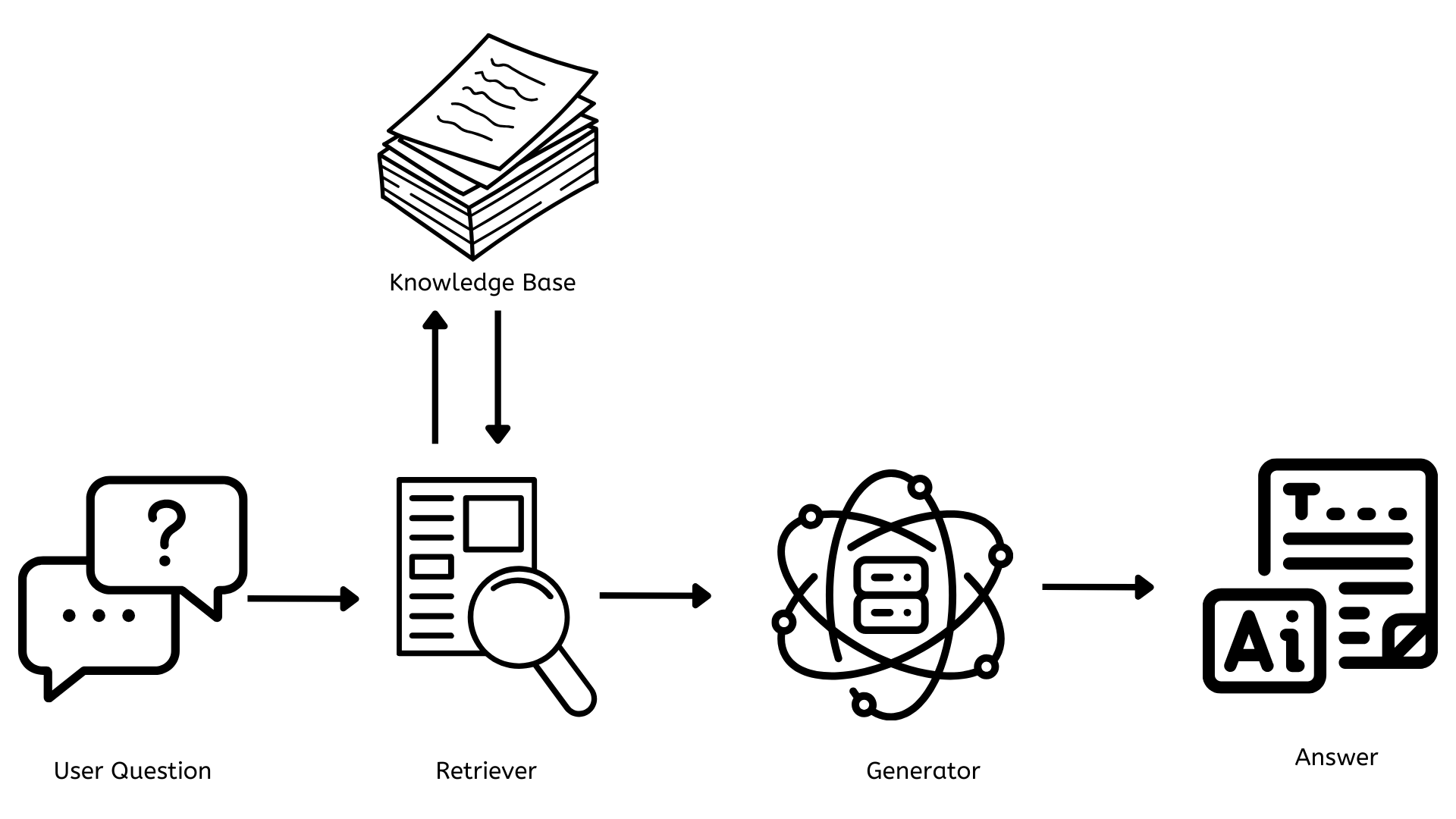

Maintenant que nous avons une bonne idée de ce que représente RAG, voyons comment il fonctionne. Commençons par une architecture simple.

Les composants clés de RAG

Apartir du diagramme d’architecture ci-dessus, entre la question de l’utilisateur et la réponse finale à la question, il existe trois composants clés qui sont cruciaux pour que RAG puisse fonctionner.

- Base de connaissances

- Retisseur

- Générateur

Maintenant, expliquons-les uns après les autres.

La Base de Connaissances

C’est le dépôt qui contient tous les documents, articles ou données qui peuvent être référencés pour répondre à toutes les questions. Cela doit être constamment mis à jour avec de nouvelles informations pertinentes afin que les réponses soient précises et que les utilisateurs soient fournis avec les informations les plus pertinentes et à jour.

D’un point de vue technologique, cela utilise généralement des base de données vectorielles telles que Pinecone, FAISS, etc., pour stocker le texte sous forme de représentations numériques (embeddings), ce qui permet des recherches rapides et efficaces.

Le Récupérateur

Il est chargé de trouver les documents ou données pertinents liés à la question de l’utilisateur. Lorsqu’une question est posée, le récupérateur recherche rapidement dans la base de connaissances les informations les plus pertinentes.

D’un point de vue technologique, cela utilise souvent des méthodes de récupération dense telles que Dense Passage Retrieval ou BM25. Ces méthodes convertissent les questions de l’utilisateur dans le même type de représentation numérique utilisée dans la base de connaissances et les matchent avec les informations pertinentes.

Le Générateur

Il est chargé de générer du contenu cohérent et contextuellement pertinent à la question de l’utilisateur. Il prend les informations du récupérateur et les utilise pour élaborer une réponse qui répond à la question.

Du point de vue technologique, ce système est alimenté par un Grand Modèle de Langage (LLM) tel que GPT-4 ou des alternatives open-source telles que LLAMA ou BERT. Ces modèles sont entraînés sur des jeux de données de taille imposante et peuvent générer du texte similaire à l’humain en fonction de l’input qu’ils reçoivent.

Avantages et Applications de RAG

Maintenant que nous savons ce que est RAG et comment il fonctionne, explorerons certains des avantages qu’il offre ainsi que des applications de RAG.

Avantages de RAG

Connaissance à jour

Contrairement aux modèles traditionnels d’IA (ChatGPT) limités à leurs données d’entraînement, les systèmes RAG peuvent accéder et utiliser les informations les plus récentes disponibles dans leur base de connaissances.

Accuracité améliorée et hallucinations réduites

RAG améliore la précision des réponses en utilisant des informations factuelles et à jour dans la base de connaissances. Cela réduit pour l’essentiel le problème des « hallucinations » – des instances où l’IA génère des informations plus plausible mais incorrecte.

Personnalisation et spécialisation

Les entreprises peuvent construire des systèmes RAG adaptés à leurs besoins spécifiques en utilisant des bases de connaissances spécialisées et en créant des assistants intelligents qui sont des experts dans des domaines spécifiques.

Transparence et explicabilité

Les systèmes RAG peuvent souvent fournir les sources de leurs informations, ce qui facilite l’ compréhension des sources par les utilisateurs, la vérification des allégations et la compréhension des raisons derrière les réponses.

Scalabilité et Efficacité

RAG permet une utilisation efficace des ressources calculatoires. Au lieu de ré-entraîner constamment de grands modèles ou de les construire à nouveau, les organisations peuvent mettre à jour leurs bases de connaissances, ce qui facilite la scalabilité et le maintien des systèmes d’IA.

Applications de RAG

Service Client

RAG rend les bots de support client plus intelligents et plus utiles. Ces bots de chat peuvent accéder à l’information la plus à jour depuis la base de connaissances et fournir des réponses précises et contextuelles.

Assistants Personnalisés

Les entreprises peuvent créer des assistants d’IA personnalisés qui peuvent accéder à leurs données spécifiques et propres. En exploitant les documents internes de l’organisation sur les politiques, procédures et autres données, ces assistants peuvent répondre rapidement et efficacement aux questions des employés.

Voix du Client

Les organisations peuvent utiliser RAG pour analyser et tirer des insights pratiques d’une variété de canaux de feedback client. Cela permet de créer une compréhension complète des expériences, des sentiments et des besoins des clients. Cela les aide à identifier rapidement et à résoudre des problèmes critiques, à prendre des décisions basées sur des données et à améliorer constamment leurs produits en fonction de l’image complète du feedback client sur tout les points de contact.

L’Avenir de RAG

RAG a émergé comme une technologie de changement de jeu dans le domaine de l’intelligence artificielle, en combinant la force des grands modèles de langage avec l’interrogation dynamique d’informations. De nombreuses organisations commencent déjà à en tirer profit et à construire des solutions personnalisées pour répondre à leurs besoins.

En regardant vers l’avenir, RAG va transformer la façon dont nous interagissons avec l’information et prenons des décisions. Les futurs systèmes RAG seront :

- dotés d’un meilleur compris contextuel et de personnalisation améliorée,

- multimodaux en passant au-delà du texte pour intégrer l’image, l’audio/vidéo,

- dotés de mises à jour de base de connaissances en temps réel,

- en mesure de s’intégrer sans interruption à de nombreux flux de travail pour améliorer la productivité et renforcer la collaboration,

Conclusion

En conclusion, RAG va révolutionner notre interaction avec l’IA et l’information. En réduisant l’écart entre le contenu généré par l’IA et son exactitude factuelle, RAG prépare le terrain pour des systèmes intelligents de l’IA qui sont non seulement plus capables mais également plus précis et de confiance. Avec cette évolution, notre engagement avec l’information sera plus efficient et précis que jamais auparavant.

Source:

https://dzone.com/articles/rag-enhancing-ai-language-models